L’adozione dell’IA nel settore dei servizi non è più una questione di “se”, ma di “come”. Con l’AI Act pienamente operativo, analizziamo le strategie obbligatorie di governance dell’Intelligenza Artificiale per garantire trasparenza, etica e conformità legale.

Il 2025 è stato l’anno della sperimentazione di massa, ma il 2026 segna l’inizio dell’era della responsabilità. Nel settore terziario l’integrazione degli algoritmi generativi (GenAI) ha trasformato radicalmente i modelli di business. Tuttavia, questa “rivoluzione cognitiva” porta con sé sfide normative senza precedenti.

L’entrata a regime delle disposizioni sanzionatorie dell’EU AI Act (regolamento sull’Intelligenza Artificiale) impone alle imprese italiane un cambio di paradigma: non basta che l’algoritmo funzioni, deve essere “spiegabile”, imparziale e monitorato. La governance dell’Intelligenza Artificiale diventa quindi l’asset strategico fondamentale per evitare sanzioni che possono raggiungere il 7% del fatturato globale e, soprattutto, per mantenere la fiducia degli stakeholder.

L’impatto dell’AI Act sulla service economy

Il regolamento europeo sull’IA ha introdotto un approccio basato sul rischio (risk-based approach) che colpisce direttamente il cuore della service economy. Molti sistemi utilizzati nel terziario, come gli algoritmi per il credit scoring (valutazione del merito creditizio) o i software per la selezione automatica del personale (HR Tech), sono classificati come sistemi ad “Alto Rischio”.

Secondo le linee guida dell’Agenzia per l’Italia Digitale (AgID) e del Garante per la Privacy, le aziende che utilizzano questi strumenti devono implementare rigorosi sistemi di governance dell’Intelligenza Artificiale. Ciò implica tre obblighi macroscopici:

- Qualità dei dati: è necessario dimostrare che i dataset utilizzati per addestrare o perfezionare i modelli siano privi di bias statistici che potrebbero portare a discriminazioni (es. un’IA che nega mutui prevalentemente a specifiche categorie demografiche).

- Trasparenza documentale: ogni decisione presa o suggerita dall’IA deve essere tracciabile. L’utente finale (cliente o dipendente) deve essere informato che sta interagendo con una macchina, come previsto dall’art. 50 dell’AI Act.

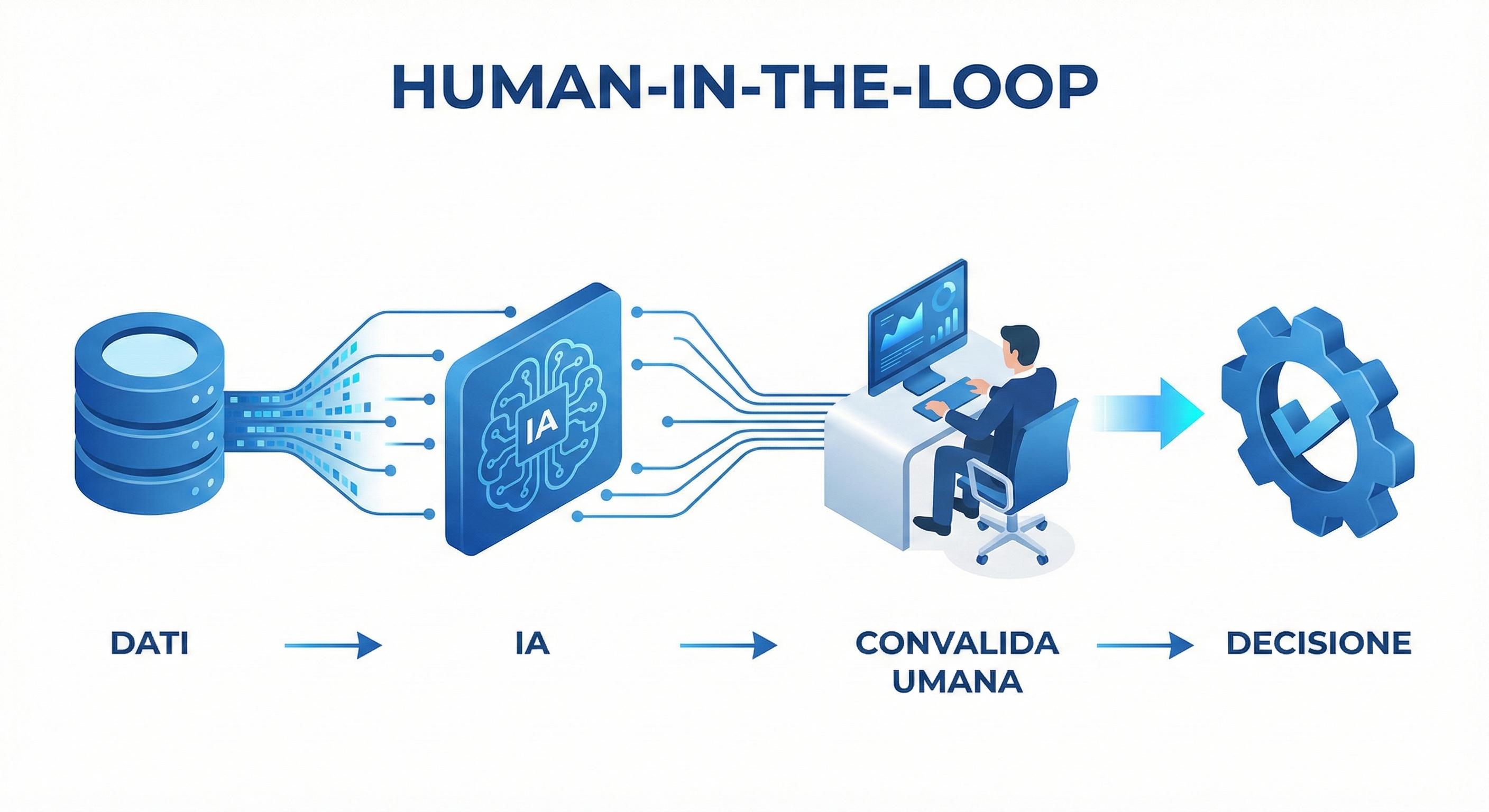

- Sorveglianza umana: il principio dello Human-in-the-loop non è più una best practice ma un requisito legale. Deve sempre esserci una persona fisica in grado di intervenire e sovrascrivere la decisione dell’algoritmo.

Etica e bias: oltre la compliance

La corretta governance dell’Intelligenza Artificiale non si esaurisce nel rispetto della legge, ma tocca la sostenibilità etica del business. L’OCSE (Organizzazione per la Cooperazione e lo Sviluppo Economico) ha aggiornato i suoi principi sull’IA sottolineando come la “robustezza tecnica” debba andare di pari passo con la “sicurezza sociale”.

Nel settore dei servizi, dove la relazione fiduciaria è tutto, un’IA che genera “allucinazioni” (informazioni false presentate come fatti) o viola il copyright può distruggere la reputazione aziendale in pochi minuti. Le imprese del terziario avanzato stanno quindi adottando protocolli di AI Ethics che includono audit esterni periodici e l’uso di “Red Teaming” (squadre di esperti che provano intenzionalmente a far sbagliare l’IA per scoprirne le debolezze prima del rilascio al pubblico).

Il ruolo dell’Innovation Manager nella governance

Chi deve gestire questa complessità? Ancora una volta, la figura dell’Innovation Manager si rivela centrale. In questo contesto, il manager dell’innovazione funge da “ponte” tra il dipartimento IT, l’ufficio legale e il board aziendale. Le competenze richieste per gestire la governance dell’Intelligenza Artificiale nel 2026 includono:

- Gestione del rischio algoritmico: saper mappare i processi aziendali dove l’IA viene impiegata e assegnare a ciascuno un livello di rischio conforme all’AI Act.

- Data literacy: comprendere la provenienza e la struttura dei dati per garantire la conformità al GDPR, che si interseca profondamente con le norme sull’IA.

- Formazione continua: educare la forza lavoro non solo all’uso dei prompt, ma alla comprensione dei limiti della macchina, promuovendo una cultura del dubbio critico.

Cosa aspettarsi dal 2026

Il 2026 non fermerà la corsa all’innovazione, ma ne traccerà le corsie. Le aziende che vedranno nella governance dell’Intelligenza Artificiale solo un costo burocratico rischiano di rimanere schiacciate dalla complessità normativa o, peggio, da incidenti reputazionali. Al contrario, chi integrerà l’etica nel design dei propri servizi digitali ne trarrà un vantaggio competitivo duraturo, offrendo ai clienti l’unica cosa che l’IA non può generare artificialmente: la fiducia.

AssoInnovatori APS supporta le imprese ed i professionisti associati con aggiornamenti costanti sulle normative e network dedicati all’etica digitale.

Automazione logistica avanzata: droni cargo, AGV e intelligenza artificiale per l’ultimo miglio

Spatial computing in ambito B2B: da Apple Vision a Meta per la formazione aziendale

Open Banking e Embedded Finance: la finanza incorporata nei software aziendali B2B

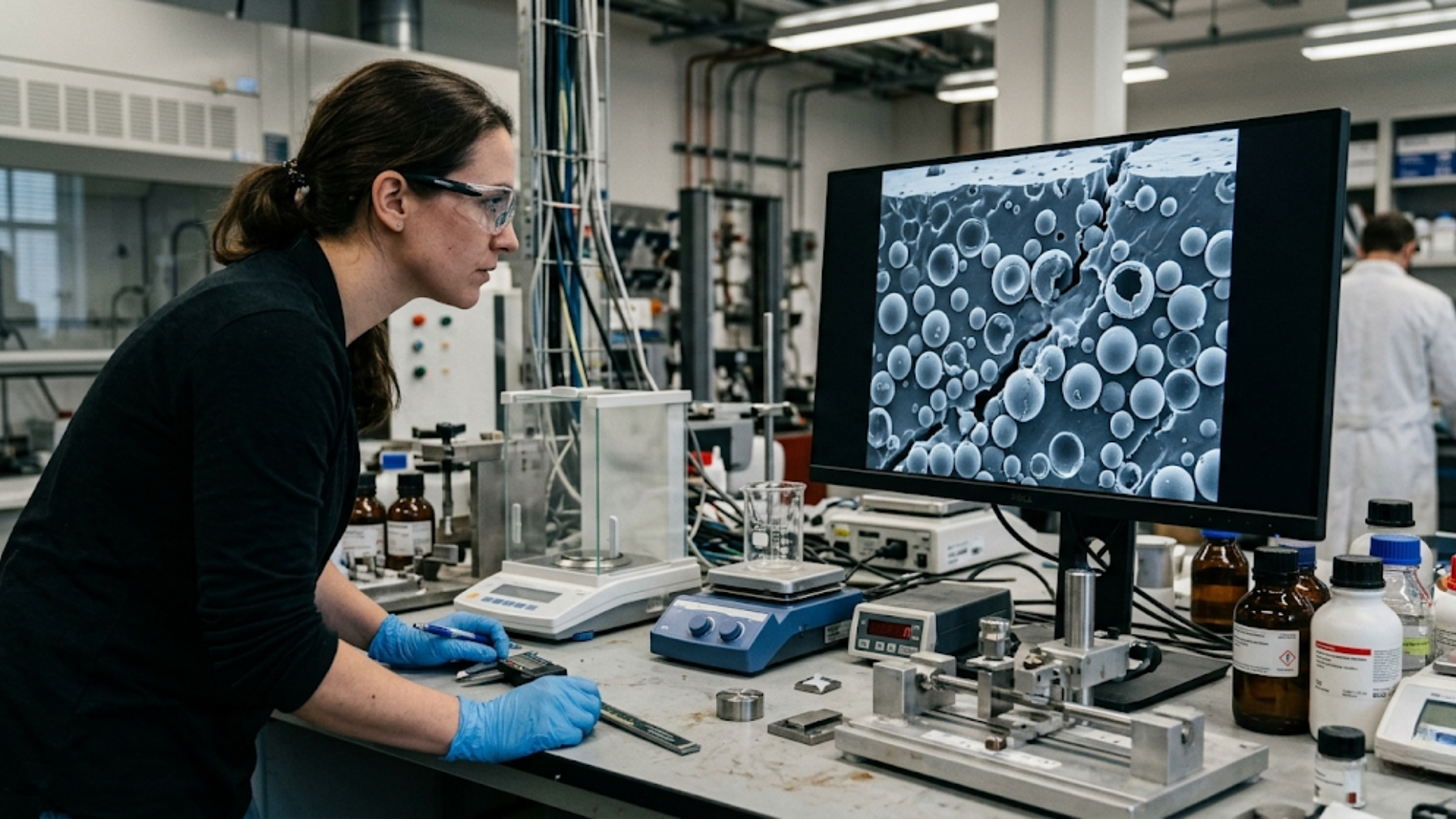

Smart materials e polimeri self-healing: l’autoriparazione strutturale nell’industria