L’intelligenza artificiale generativa elabora documenti complessi con una velocità irraggiungibile per l’essere umano. I modelli linguistici possono riassumere bilanci finanziari, analizzare contratti legali o scrivere codice informatico in pochi secondi. L’adozione di questi strumenti aumenta drasticamente la produttività negli uffici moderni. Tuttavia, l’uso di piattaforme pubbliche in cloud ha generato ostacoli enormi per la sicurezza informatica. Inserire dati riservati in interfacce gestite da terzi espone l’azienda a rischi inaccettabili.

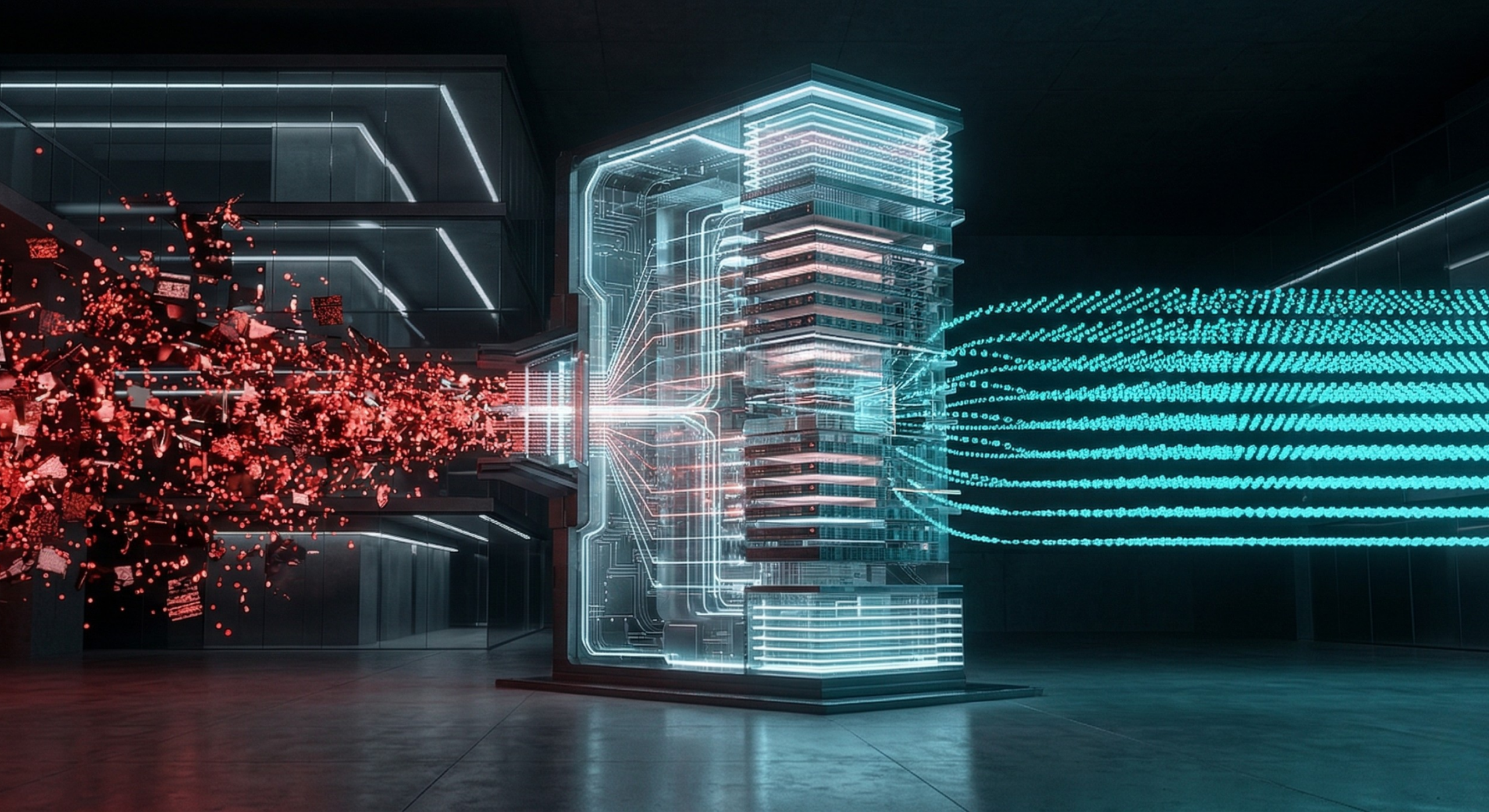

L’innovazione informatica ha risolto questo paradosso riportando l’infrastruttura fisicamente all’interno dell’azienda. Le imprese moderne installano modelli linguistici privati direttamente sui propri server locali. Questa architettura ingegneristica prende il nome di infrastruttura on-premise. Tale configurazione garantisce l’isolamento totale dei dati aziendali dalla rete internet pubblica. L’articolo di oggi esplora le dinamiche profonde di questa complessa implementazione tecnica. Analizzeremo le reti neurali locali, l’architettura RAG e le moderne tecniche di ottimizzazione hardware.

I rischi della Data Exfiltration e la conformità al GDPR

L’utilizzo di un’intelligenza artificiale pubblica comporta un flusso continuo di informazioni verso l’esterno. Quando un dipendente carica un brevetto su una piattaforma Cloud, i dati abbandonano l’azienda. Queste informazioni sensibili finiscono inevitabilmente sui server di una società tecnologica terza. Molto spesso, le condizioni d’uso permettono a queste società di sfruttare i testi inseriti dagli utenti. I dati aziendali riservati vengono usati per riaddestrare e migliorare i loro algoritmi globali.

Questa pratica rappresenta una violazione diretta del GDPR e dei protocolli di segretezza industriale. Le informazioni coperte da segreto commerciale diventano potenzialmente vulnerabili. Un ingegnere esperto potrebbe estrarre quei dati dal modello pubblico utilizzando prompt specifici. Per fermare questa esfiltrazione di dati, i dipartimenti IT spesso bloccano i siti di intelligenza artificiale. Purtroppo, bloccare la tecnologia significa perdere produttività e competitività sul mercato. L’unica soluzione infrastrutturale sicura richiede la chiusura del sistema all’interno della Intranet aziendale.

Architettura on-premise e la scelta dei modelli Open-Source

La creazione di un LLM aziendale richiede l’acquisizione di un modello matematico di base. L’azienda scarica modelli open-source altamente performanti e liberamente accessibili. Il panorama odierno offre reti neurali estremamente avanzate e ottimizzate per l’uso commerciale. Questo file, contenente i pesi matematici della rete neurale, viene scaricato fisicamente e salvato. Viene poi installato nei server del data center aziendale, dietro il firewall di sicurezza.

Questa configurazione on-premise garantisce un isolamento logico e strutturale perfetto. L’intelligenza artificiale non comunica mai con il mondo esterno per funzionare. Le domande poste dai dipendenti e i file elaborati rimangono intrappolati nella rete locale. L’elaborazione neurale avviene esclusivamente sulle macchine di proprietà dell’impresa. Nessun dato strategico alimenterà mai gli algoritmi di società terze o fornitori esterni. I responsabili della sicurezza mantengono il dominio assoluto sui log informatici. L’intelligenza artificiale diventa un patrimonio aziendale invisibile dall’esterno e totalmente sicuro.

RAG e database vettoriali per l’interrogazione documentale

Un LLM appena scaricato possiede una cultura generale enciclopedica ma generica. Conosce perfettamente la sintassi e la logica, ma ignora completamente l’azienda che lo ospita. Non sa assolutamente nulla delle procedure interne, dei cataloghi o dei clienti storici. Le imprese superano brillantemente questo limite impiegando l’architettura RAG (Retrieval-Augmented Generation). Il sistema RAG collega l’intelligenza artificiale all’archivio documentale interno dell’impresa.

Questa integrazione avviene tramite l’uso di complessi database vettoriali. I manuali tecnici e i PDF aziendali vengono frammentati e trasformati in coordinate matematiche (vettori). Quando l’utente fa una domanda, il sistema cerca la risposta confrontando le coordinate nel database. Estrae i paragrafi pertinenti e li invia all’LLM insieme alla domanda originale. Il modello linguistico legge il testo ufficiale e formula una risposta contestualizzata e precisa. Questa architettura impedisce matematicamente all’algoritmo di inventare risposte false. Il sistema si trasforma in un archivista infallibile e velocissimo.

Ottimizzazione hardware: quantizzazione e tecniche PEFT (LoRA)

Eseguire un LLM in locale richiede enormi risorse ingegneristiche e hardware. La generazione fluida del testo esige una potenza di calcolo parallela impressionante. I normali server CPU sono totalmente inadatti. Servono cluster di schede video (GPU) con moltissima memoria interna (VRAM). Per abbattere i costi hardware, gli sviluppatori applicano tecniche matematiche di compressione. La quantizzazione riduce la precisione dei numeri decimali usati dalla rete neurale. Comprime il modello e riduce drasticamente la quantità di RAM necessaria per l’esecuzione.

Inoltre, alcune aziende desiderano addestrare ulteriormente il modello locale per compiti iperspecializzati. L’addestramento tradizionale di una rete neurale richiede mesi e costi energetici proibitivi. Oggi si utilizzano le tecniche PEFT (Parameter-Efficient Fine-Tuning), come il protocollo LoRA. Questo sistema non modifica l’intera rete neurale originaria. Aggiunge invece piccoli moduli matematici esterni che alterano il comportamento del modello base. Questa tecnica permette di specializzare un’intelligenza artificiale su un server locale in pochissime ore.

Role-Based Access Control (RBAC) nei sistemi di IA

Mantenere il server fisicamente chiuso in azienda non risolve tutti i problemi di sicurezza. Bisogna proteggere i dati anche dalle minacce e dalle gerarchie interne. Non tutti i dipendenti devono avere accesso allo stesso livello di informazioni. Un tirocinante non deve poter usare l’intelligenza artificiale per interrogare i bilanci riservati della direzione.

L’architettura del sistema deve includere protocolli rigidi di Role-Based Access Control (RBAC). Quando un impiegato effettua l’accesso alla chat aziendale, il sistema RAG riconosce le sue credenziali. L’intelligenza artificiale riceve il permesso di cercare le risposte solo in cartelle specifiche. L’algoritmo leggerà esclusivamente i documenti a cui quell’utente ha formalmente e legalmente accesso. La compartimentazione dei dati aziendali viene mantenuta intatta anche all’interno del motore di intelligenza artificiale.

Linee guida per l’integrazione architetturale

L’implementazione degli LLM privati per l’enterprise richiede una progettazione IT rigorosa. Ricapitoliamo i pilastri fondamentali per una corretta infrastruttura on-premise:

- Separazione fisica delle reti: I server GPU dedicati all’intelligenza artificiale devono risiedere in VLAN separate. Non devono avere alcun routing di rete verso l’esterno.

- Integrazione tramite API locali: I gestionali aziendali, come ERP e CRM, non devono inviare dati al modello in modo disordinato. L’integrazione avviene tramite API REST interne e crittografate.

- Versionamento dei Database Vettoriali: I documenti aziendali cambiano nel tempo. I database vettoriali devono essere aggiornati quotidianamente con procedure automatizzate per evitare che l’AI fornisca risposte basate su manuali ormai obsoleti.

Logistica urbana e droni cargo (UAV): l’automazione dell’ultimo miglio

Agribot e computer vision: il diserbo laser per l’agricoltura a zero erbicidi

Neuromarketing e Brain-Computer Interfaces (BCI): analisi dei segnali neurofisiologici per la validazione di prodotti e servizi

Celle a combustibile a ossido solido (SOFC): efficienza energetica e decarbonizzazione nei processi industriali ad alta temperatura